Używanie dużych modeli językowych obniża funkcje poznawcze ludzi

Zespół z MIT Media Lab, kierowany przez badaczkę Nataliyę Kos’minę po raz pierwszy w historii przeanalizował aktywność mózgu osób korzystających z dużych modeli językowych, takich jak ChatGPT, porównując je z osobami, które pisały teksty bez wsparcia sztucznej inteligencji.

Wyniki tego eksperymentu nie tylko wstrząsnęły środowiskiem akademickim, ale także wywołały szeroką debatę na temat wpływu AI na naszą zdolność do myślenia, uczenia się i zapamiętywania.

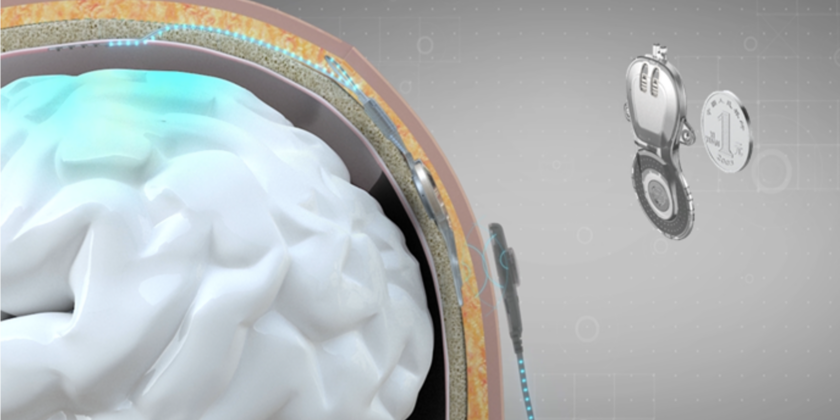

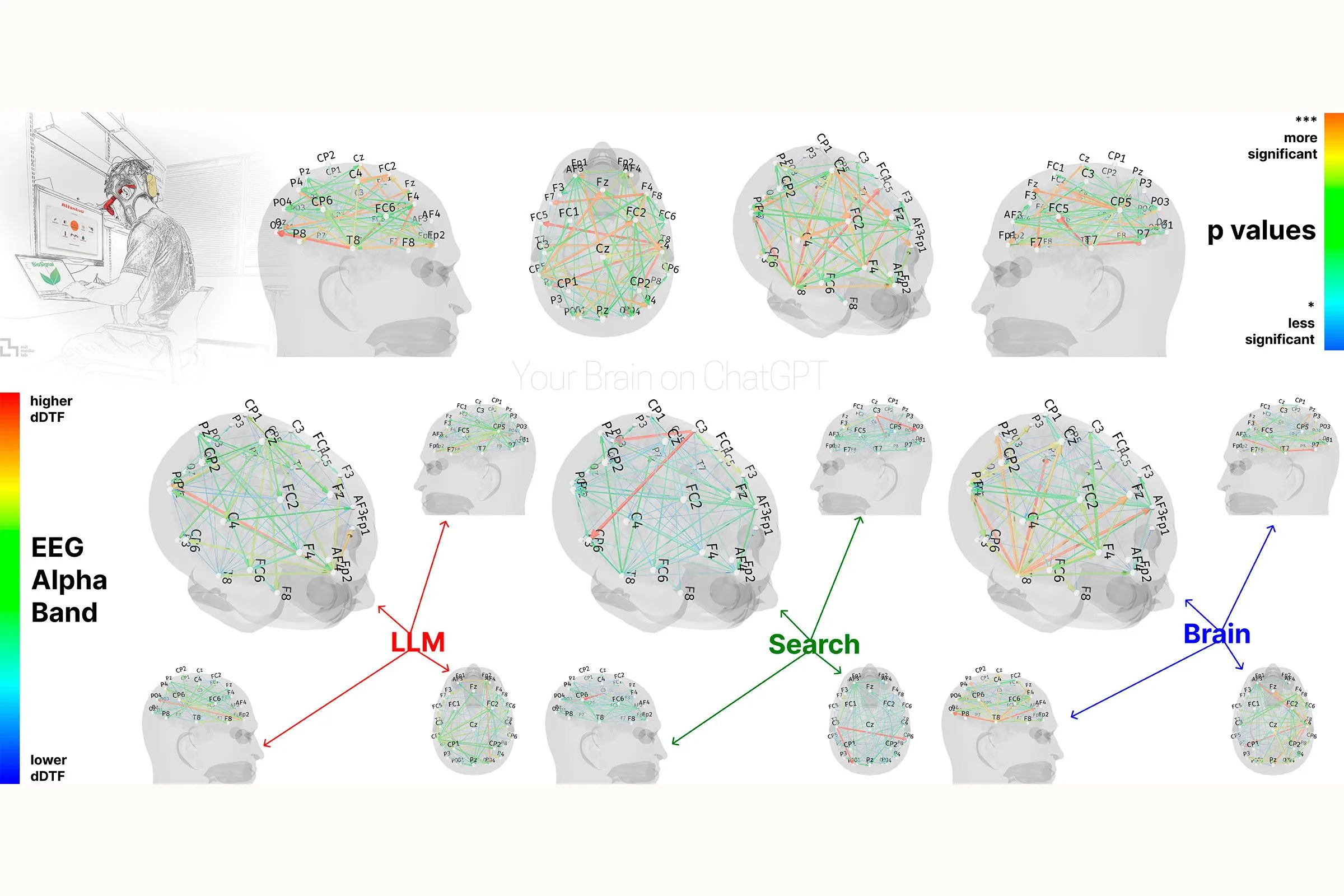

Do badania zaproszono 54 uczestników w wieku od 18 do 39 lat. Podzielono ich na trzy grupy: pierwsza pisała eseje z pomocą ChatGPT (grupa LLM), druga mogła korzystać z wyszukiwarki Google (grupa Search Engine), a trzecia pisała samodzielnie, bez jakiejkolwiek pomocy cyfrowej (grupa Brain-only). Każdy uczestnik pisał trzy eseje – po jednym w miesiącu – w tych samych warunkach, a następnie w czwartej sesji ich narzędzia zostały zamienione. Osoby wcześniej korzystające z ChatGPT musiały pisać bez niego, natomiast ci, którzy wcześniej nie mieli dostępu do AI, otrzymali możliwość skorzystania z niego. W trakcie pisania uczestnicy mieli założone czepki EEG, mierzące aktywność ich mózgu w różnych pasmach fal mózgowych: alfa, beta i theta. Oceniano także same eseje – za pomocą algorytmów językowych, nauczycieli akademickich oraz systemów sztucznej inteligencji. Dodatkowo przeprowadzono testy pamięciowe oraz ankiety mierzące poczucie autorstwa, satysfakcję i poziom wysiłku intelektualnego.

Rezultaty były jednoznaczne i zaskakujące. Osoby piszące samodzielnie (grupa Brain-only) wykazywały najwyższą aktywność mózgową – ich EEG pokazywało rozbudowaną sieć połączeń w wielu obszarach kory mózgowej, zwłaszcza odpowiedzialnych za myślenie analityczne, pamięć roboczą i planowanie. Grupa korzystająca z wyszukiwarki Google miała nieco niższą, ale wciąż aktywną mapę fal mózgowych. Natomiast uczestnicy korzystający z ChatGPT wykazywali najniższą aktywność neuronalną – ich mózgi były zauważalnie mniej zaangażowane podczas pisania. Spadki dotyczyły przede wszystkim fal beta, związanych z koncentracją, oraz fal theta, kojarzonych z kreatywnością i tworzeniem nowych połączeń semantycznych.

Wnioski były jednoznaczne: im większe było wsparcie ze strony technologii, tym mniejszy był poznawczy wysiłek wkładany w zadanie.

ChatGPT umożliwiał szybsze i bardziej płynne pisanie – uczestnicy z tej grupy byli średnio o 60% szybsi w produkowaniu tekstów – ale kosztem głębszego przetwarzania informacji. Analizy NLP wykazały, że eseje pisane z pomocą AI były stylistycznie poprawne, ale powierzchowne, mniej oryginalne i pozbawione osobistego tonu. Co więcej, aż 83% osób z grupy LLM nie było w stanie w kolejnych tygodniach przypomnieć sobie ani jednej frazy z własnych esejów, co wskazuje na brak trwałego zakodowania treści w pamięci. Jeszcze ciekawsze były wyniki z czwartej sesji, w której zmieniono warunki eksperymentu. Osoby, które przez trzy miesiące korzystały z ChatGPT, a w ostatnim zadaniu musiały pisać bez niego, wykazywały wciąż niską aktywność EEG – nie potrafiły już wrócić do wcześniejszego, pełnego zaangażowania poznawczego.

Efekt ten nazwano „długiem poznawczym” – chronicznym obniżeniem funkcji poznawczych wywołanym przez nawykowe delegowanie myślenia na AI.

Z kolei osoby, które dotąd pisały samodzielnie, a w ostatniej sesji mogły użyć ChatGPT, wykazywały umiarkowane spadki aktywności, porównywalne z grupą korzystającą z Google. To sugeruje, że pierwszy kontakt z AI nie niszczy od razu zdolności poznawczych, ale regularne i długotrwałe użycie może prowadzić do utrwalonych zmian. Badacze zauważyli także istotną różnicę w poczuciu autorstwa i emocjonalnego zaangażowania. Osoby z grupy Brain-only wyrażały większą satysfakcję z wykonania zadania, silniejsze poczucie własności intelektualnej oraz większe przywiązanie do napisanego tekstu. Użytkownicy ChatGPT deklarowali co prawda większą łatwość i płynność, ale również dystans emocjonalny wobec treści oraz trudność w identyfikowaniu się z własnym dziełem.

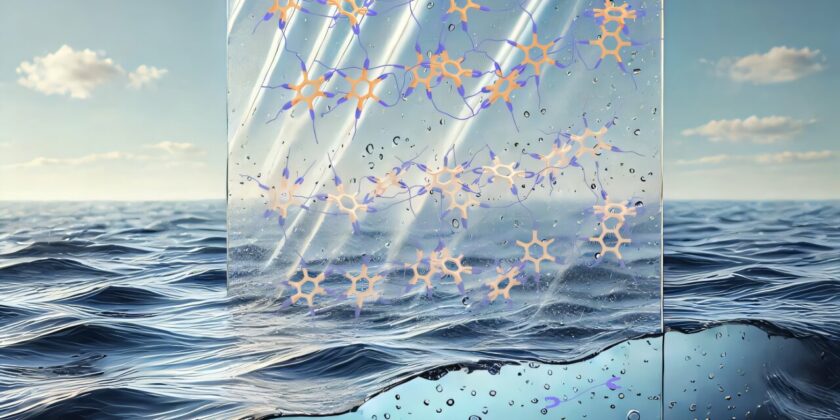

Wnioski płynące z tego badania są zarówno ostrzeżeniem, jak i wskazówką. Z jednej strony potwierdzają, że narzędzia oparte na AI, takie jak ChatGPT, mogą skutecznie wspierać proces twórczy, przyspieszać pracę i ułatwiać dostęp do informacji. Z drugiej strony pokazują, że bezrefleksyjne poleganie na nich może prowadzić do atrofii zdolności poznawczych, spadku pamięci trwałej i utraty głębokiego zaangażowania intelektualnego.

To nie krytyka samego narzędzia, ale wezwanie do świadomego i odpowiedzialnego korzystania z jego potencjału.

Badanie MIT Media Lab nie tylko otwiera nowy rozdział w nauce o relacji człowieka i technologii, ale też stawia poważne pytania przed systemami edukacyjnymi, twórcami polityk publicznych i każdym z nas jako indywidualnym użytkownikiem. Jeśli sztuczna inteligencja staje się integralnym narzędziem naszej codzienności, to musimy nauczyć się korzystać z niej w sposób, który nie zastępuje myślenia, ale je wspiera. Potrzebna jest nowa forma edukacji cyfrowej – nie polegająca na unikaniu AI, ale na uczeniu, kiedy, jak i po co po nią sięgać. Tylko wtedy technologia stanie się narzędziem emancypacji, a nie uśpienia umysłu.

36k

36k